Où va la physique des particules élémentaires ?

La physique des particules occupe près de 20 000 personnes dans le monde, dont 13 000 travaillent pour le CERN. La mise en évidence du boson « de Higgs » en 2012 a constitué une confirmation éclatante du « modèle standard », mais a permis aussi de lister toutes les questions qui restent ouvertes. Le LHC devrait rester en service jusqu’à 2035, en voyant ses performances augmenter régulièrement. L’exploration des propriétés des neutrinos se poursuit notamment aux États-Unis, au Japon

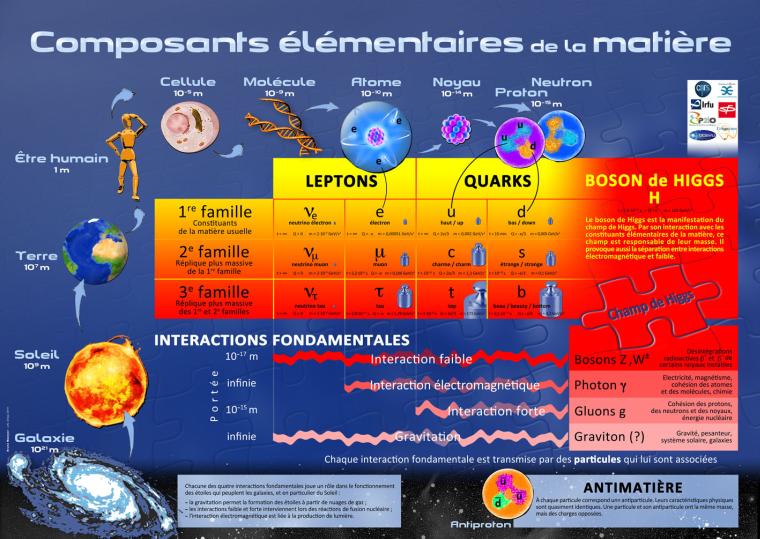

La physique des particules ou physique subatomique est la branche de la physique qui étudie les constituants élémentaires de la matière et les rayonnements, ainsi que leurs interactions.

La recherche en physique des particules, c’est aujourd’hui une communauté de près de 20 000 chercheurs du monde entier. Les uns ont un profil plus tourné vers les aspects théoriques, d’autres vers un aspect expérimental et d’autres sont des ingénieurs de recherche.

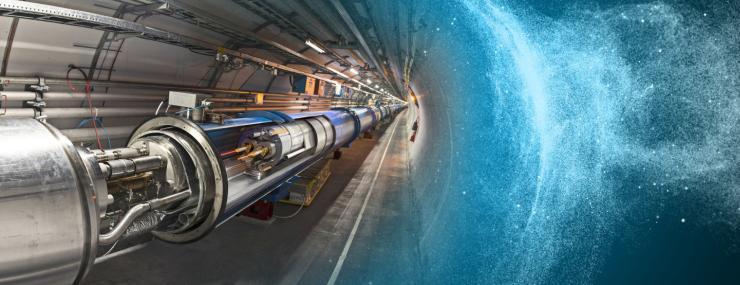

Ces recherches se font principalement auprès d’accélérateurs : aux États-Unis sur les neutrinos, des particules énigmatiques et « passe muraille » (environ 2 000 chercheurs) ; en Asie (1 500 chercheurs environ), notamment au Japon là aussi sur les neutrinos mais aussi sur les différences de comportement entre particules et antiparticules ; mais surtout au Cern à Genève où viennent travailler près de 13 000 chercheurs du monde entier dont 11 500 sur le LHC (Large Hadron Collider), la machine qui fournit des collisions proton – proton mais aussi plomb – plomb (pour étudier les effets collectifs) aux plus hautes énergies jamais atteintes avec des accélérateurs.

REPÈRES

Avec la découverte du boson de Brout, Englert et Higgs du nom des trois physiciens qui ont conçu le mécanisme associé en 1964, le modèle standard de la physique des particules constitue un nouveau palier de la connaissance. Il permet de rendre compte de toutes les mesures faites auprès des accélérateurs de particules de haute énergie.

Il est basé sur des briques élémentaires de matière (des fermions de spin ½) que sont les quarks et les leptons et sur des particules médiatrices des forces (des bosons de spin 1) : les gluons pour l’interaction forte, les photons pour l’interaction électromagnétique, les bosons intermédiaires pour l’interaction faible.

Il est à noter que plus de 3 000 chercheurs de par le monde font de la physique des particules sans accélérateurs (sur les neutrinos, les rayons cosmiques et la cosmologie observationnelle à travers la recherche de la nature de la matière sombre et de la constante cosmologique ou énergie du vide).

UN SUCCÈS DE LA « COOPÉTITION »

La construction du LHC et des détecteurs, ATLAS, CMS (détecteurs généralistes), LHCb (focalisé sur les différences de comportement entre particules et antiparticules), ALICE (focalisé sur les collisions Pb-Pb), a entraîné des défis majeurs qui n’ont pu être surmontés qu’après l’approbation de la machine et des expériences, ce qui constituait un pari audacieux.

Ce n’est que grâce à un type original d’organisation, basé sur la collaboration intensive du Cern avec les laboratoires nationaux et universitaires du monde entier, avec la participation d’industriels dès la conception, que ces défis ont pu être surmontés : hauts champs magnétiques, cryogénie, mécanique de précision, électrotechnique, électronique résistante aux radiations, traitements massifs des données, contrôle commande, simulations géantes, outils collaboratifs innovants, logiciels complexes, outils collaboratifs innovants, etc.

Ce modèle qu’on appelle au Cern « la coopétition », mélange de collaboration et d’émulation, est un modèle ouvert qui pourrait être exportable, mais c’est un autre sujet…

C’est donc, par beaucoup de critères, le plus grand effort collaboratif jamais réalisé, l’une des plus grandes aventures scientifiques humaines. Conçu en 1984, approuvé par le Conseil du Cern en 1994, le LHC a démarré en 2010 et devrait fonctionner jusqu’en 2035.

Il a fallu et il faut toujours une chaîne de solidarité multilatérale sans faille et dans la durée entre la communauté scientifique, le soutien de leurs laboratoires, de leurs agences financières et de leurs gouvernements.

Les Américains qui avaient un projet similaire, le SSC, n’ont pu tenir la durée et l’ont stoppé de manière unilatérale, par une décision du Congrès en 1993.

LE « MODÈLE STANDARD », NOUVEAU PALIER DE LA CONNAISSANCE

Comme expliqué dans l’encadré Repères , le modèle standard rend compte des observations faites dans les grands accélérateurs de particules. Dans ce modèle, c’est une brisure spontanée de la symétrie électrofaible SU(2) x U(1) qui génère la masse des particules.

Cette propriété de masse peut être attribuée aux propriétés du vide quantique et du champ de Brout, Englert et Higgs. À ce champ est associée une particule, abusivement appelée le boson de Higgs.

Tout ce que l’on savait, c’est que sa masse devait être inférieure à 1 TeV/c2 (1 TeV = 1012 eV, c : vitesse de la lumière), et donc accessible au LHC qui collisionne des protons, chacun de plusieurs TeV d’énergie. Le boson de Brout, Englert et Higgs constituait donc la pierre angulaire du modèle standard et seul le LHC pouvait répondre de manière non ambiguë sur son existence ou non. D’où la décision de le construire.

Le site du Cern : on peut voir en jaune la trace au sol de la machine souterraine LHC ainsi que la trace des injecteurs. Sont montrées aussi une coupe de cette machine ainsi qu’une coupe des détecteurs qui ont la taille de cathédrales.

© MAXIMILIEN BRICE, MICHAËL HOCH, CLAUDIA MARCELLONI / CERN

LE CERN, CAPITALE MONDIALE DE LA PHYSIQUE DES PARTICULES AVEC LE LHC

Le Cern, organisation internationale, et son site sont devenus la capitale mondiale de la physique des particules avec le LHC, la machine frontière des collisions à haute énergie, de 27 km de circonférence (le « seigneur des anneaux ») ; avec le personnel de 3 000 personnes sur le site de Genève, qui a construit et exploite cette machine ; avec la communauté mondiale des 13 000 chercheurs utilisateurs du Cern (« la communauté de l’anneau ») qui a construit et opère les détecteurs. Le Cern est né en 1954 pour redonner une chance à l’Europe de rivaliser avec les États-Unis et l’URSS dans le domaine de la physique fondamentale des particules. Le premier vœu des fondateurs visionnaires est ainsi exaucé, voire dépassé.

DES IMPLICATIONS POUR LA COSMOLOGIE

Le nouveau palier de la connaissance atteint avec le modèle standard de la physique des particules permet de construire un nouveau récit consolidé de l’histoire de l’univers observable. Tout l’univers observable était concentré en une toute petite région (« un point ? »), il y a 13,8 milliards d’années.

En un instant très bref (10-35 s), « le big-bang », une énergie issue du vide (fluctuation quantique ?), « fait jaillir l’espace et le temps », et se transforme en une soupe de particules très chaude, indifférenciée et de masse nulle.

L’expansion de l’espace fait refroidir cette soupe. Quelques picosecondes (10-12 s) plus tard, lorsque la température baisse en dessous de 1 TeV, le vide quantique connaît une transition de phase avec une brisure spontanée de symétrie liée au champ de Brout, Englert et Higgs : la brisure de la symétrie électrofaible.

Les particules deviennent massives et se différencient. C’est à ce moment que le photon, donc la lumière, se différencie.

ET LA LUMIÈRE FUT…

Quelques microsecondes (10-6 s) plus tard, les quarks et les gluons se regroupent en protons et neutrons. Quelques minutes plus tard, les noyaux se forment et au bout de 380 000 ans les atomes se forment.

THÉORIE QUANTIQUE RELATIVISTE DES CHAMPS

La théorie sous-jacente est la théorie quantique des champs relativistes couplée à des symétries : la symétrie SU(3) de couleur des quarks (un degré de liberté interne des quarks qui n’apparaît pas sur la figure) associée à l’interaction forte, la symétrie SU(2) dans les doublets de quarks et de leptons associée à l’interaction faible et la symétrie U(1) liée à une charge généralisée associée à l’interaction électromagnétique.

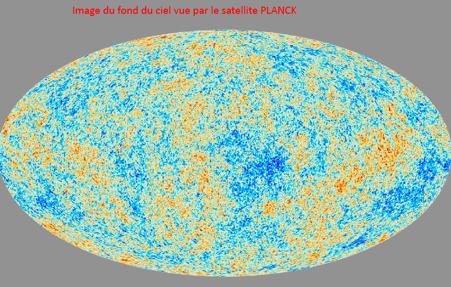

À cet instant l’univers devient une soupe d’atomes électriquement neutre. Il est alors transparent (auparavant c’était un plasma chargé), et la lumière peut ainsi voyager librement et parvenir jusqu’à nous.

Cette image de l’univers primordial, « le fond du ciel », due à une soupe d’atomes en formation a été reconstituée récemment avec précision par le satellite Planck. Elle est extrêmement homogène avec des contrastes de seulement quelques 10-5. Ces contrastes néanmoins sont la source de la structuration de l’univers qui suivra au cours des 13,8 milliards d’années et prennent sans doute leur source dans les fluctuations quantiques du vide d’où l’univers observable aujourd’hui a surgi.

On pourrait, à la lecture de ce qui précède, penser que toutes les questions fondamentales concernant la matière et l’univers sont résolues. Il n’en est rien. Voici une liste de questions fondamentales qui préoccupent grandement physiciens et astrophysiciens.

LA MATIÈRE SERAIT-ELLE SURTOUT « SOMBRE » ?

L’analyse des mouvements des galaxies dans les amas de galaxies et des mouvements des étoiles et du gaz dans les galaxies indique la présence de halos massifs constitués d’une matière pesante qui n’est pas la matière connue faite des atomes de la table de Mendeleïev.

Cette matière sombre porterait cinq fois plus de masse dans l’univers que n’en porterait la matière ordinaire faite des atomes connus, c’est-à-dire que n’en porteraient les étoiles, les planètes et le gaz que l’on peut voir dans l’univers.

L’hypothèse la plus répandue est que cette matière serait faite d’un nouveau type de particules élémentaires, neutres électriquement et interagissant faiblement. Ces particules sont activement recherchées auprès du LHC mais aussi dans notre environnement puisque nous baignons dans leur halo.

POURQUOI CES DIFFÉRENCES D’ÉCHELLE DE MASSE/ ÉNERGIE ?

Pourquoi deux échelles aussi différentes dans l’histoire de l’univers : l’échelle de l’inflation, du big-bang initial de 1012 TeV et l’échelle électrofaible de brisure de symétrie liée au mécanisme de Brout, Englert et Higgs de l’ordre de 1 TeV ? Y a‑t-il une explication à cette hiérarchie des échelles ? C’est ce que propose la supersymétrie, une symétrie entre fermions et bosons qui laisserait à penser que chaque fermion connu a un partenaire bosonique à découvrir et chaque boson connu a un partenaire fermionique à découvrir.

La plus légère de ces particules miroirs devrait être stable et pourrait constituer la matière sombre. Là encore, ces particules sont activement recherchées au LHC.

CONSTANTE COSMOLOGIQUE ET ÉNERGIE DU VIDE

On ne sait pas aujourd’hui traiter la gravitation par la théorie quantique des champs relativistes, mais il est tentant d’associer la constante cosmologique à l’énergie du vide quantique.

Les différentes valeurs de la constante cosmologique dans l’histoire de l’univers seraient alors dues à des transitions de phase du vide quantique, du type de celle induite par le mécanisme de Brout, Englert et Higgs. C’est un champ de controverse et d’études aujourd’hui.

Image de l’univers lorsqu’il n’était « qu’une soupe » d’atomes en formation, image du « fond du ciel » vue par le satellite Planck.

© ESA AND THE PLANCK COLLABORATION

CONSTANTE COSMOLOGIQUE ET EXPANSION

Après une période d’expansion initiale accélérée très brève, l’univers a connu une décélération de son expansion, puis semble à nouveau réaccélérer son expansion depuis quelques milliards d’années. Dans la théorie de la gravité d’Einstein, ces accélérations sont dues à ce qu’on appelle la constante cosmologique.

OÙ EST DONC PASSÉE L’ANTIMATIÈRE ?

Aussi loin que l’on scrute l’univers, on n’y voit que de la matière et du rayonnement. Pas de trace d’antimatière, pas « d’antiétoiles ». Pourtant, dans les collisions de particules, l’énergie se transforme en autant de particules que d’antiparticules.

Les antiparticules ont les mêmes masses que les particules, interagissent de la même manière mais avec des charges opposées. Si l’univers observable a jailli d’une énergie qui s’est matérialisée en une soupe de particules, il devrait y avoir autant de particules que d’antiparticules et donc autant de matière que d’antimatière.

VERS LA GRAVITÉ QUANTIQUE

Comme indiqué précédemment, l’unification de la force de gravitation avec la théorie quantique reste à faire. De nombreuses tentatives ont été et sont entreprises mais aucune ne s’est imposée jusqu’ici.

Souvent ces tentatives font appel à de nouvelles dimensions repliées et cachées auxquelles les collisions de haute énergie pourraient avoir accès. C’est encore un sujet d’étude au LHC.

La découverte récente des ondes gravitationnelles permettra peut-être un pas vers la gravité quantique de la même manière que la découverte des ondes électromagnétiques a été un pas vers la découverte du photon.

HASARD, NÉCESSITÉ ET ÉMERGENCE

Enfin, et à la limite des spéculations métaphysiques, certains s’interrogent sur le fait de savoir si certains aspects de l’univers observable et de son histoire sont dus au hasard ou à des lois qui restent à découvrir à cause des ajustements fins nécessaires pour décrire certains phénomènes, en l’absence de nouvelle loi contraignante.

LES PERSPECTIVES DE DÉCOUVERTES JUSQU’EN 2035

ÉNIGMATIQUES NEUTRINOS

Les neutrinos sont des particules élémentaires, beaucoup moins massives que les autres particules élémentaires. Leur masse vient-elle du mécanisme de Brout, Englert et Higgs ou d’un mécanisme lié à une physique nouvelle au-delà du modèle standard ?

Le LHC continuera à opérer jusqu’en 2035. Le taux de collisions sera constamment accru grâce à des améliorations technologiques. D’ici 2035, le LHC devrait produire cent fois plus de collisions qu’il n’en a produits aujourd’hui. Son énergie sera aussi légèrement augmentée.

Cela devrait permettre peut-être de découvrir de nouvelles particules, signal d’une nouvelle physique au-delà du modèle standard ou de faire des mesures de précision (notamment sur les modes de désintégration du boson de Brout, Englert et Higgs) qui pourront être confrontées aux prédictions du modèle standard et peut-être le mettre en défaut.

En parallèle, l’exploration des propriétés des neutrinos, notamment aux États-Unis, au Japon, se poursuivra. Les recherches sur les différences de comportement entre les particules et antiparticules se poursuivront à la fois au Japon et au LHC au CERN.

Enfin la recherche et l’identification de la matière sombre dans notre environnement sont et seront l’objet d’études à travers le monde.

L’APRÈS 2035

En 2020–2025, avec tous les résultats disponibles à ce moment, il sera sans doute temps d’envisager quelle machine pourrait succéder au LHC pour fournir ses premières collisions vers 2040 : un collisionneur linéaire électron-positron de quelques TeV pour étudier avec précision des particules nouvelles qu’on aurait trouvées au LHC ? Ou un futur collisionneur circulaire de 100 km de circonférence, avec les technologies les plus développées du moment, pour atteindre 100 TeV, près de dix fois plus que l’énergie atteinte au LHC, pour ouvrir une nouvelle fenêtre sur l’infiniment petit (une alternative pourrait être de réutiliser le tunnel du LHC, mais on atteindrait une énergie moindre) ?

Ou encore une machine basée sur des nouvelles techniques d’accélération (les lasers et les plasmas semblent les plus prometteurs) ?

Dans tous les cas une telle machine nécessitera une motivation scientifique forte portée par une communauté mondiale (comme c’était le cas pour le LHC), des défis technologiques (qui présentent un intérêt pour la société), un coût abordable et une acceptabilité environnementale.

À titre personnel, j’espère surtout que cette aventure de la connaissance sera pérenne : c’est une part d’infini que nous avons en nous.

D’ici 2035, le LHC devrait produire cent fois plus de collisions qu’il n’en a produits aujourd’hui.

© DOMINGUEZ, DANIEL ; BRICE, MAXIMILIEN / 2015–2016 CERN

Le Cern et le boson de Higgs, par Michel Spiro (11 min.)